人体部位检测:Hier R-CNN

Hier R-CNN: Instance-Level Human Parts Detection and A New Benchmark解读

- 摘要

- 1. 简介

- 2. RELATED WORK

- 2.1 Human Parts Datasets

- 2.2 Region-Based Approach

- 2.3 Instance-Level Human Analysis

- 3. COCO Human Parts dataset

- 3.1 Overview

- 3.2 Dataset Statistics

- 3.3 Evaluation Protocols (评价方案)

- 4. Hier R-CNN

- 4.1 Architecture

- 4.2 Human Parts Detection的解耦

- 4.3 Hierarchical 分支

- (1)The Input Feature Maps

- (2)Ground Truth of Targets

- (3)Fully Convolutional Branch and Outputs

- (4)Loss Functions

- (5)Network Inference

- 4.4 Proposals Sampling and Augmenting

- (1)Proposals Sampling

- (2)Proposals Augmenting

- 5. 实验

- 5.1 Baseline of Detectors

- (1)Training Setup

- (2)Detection Results

- 5.2 Generalization Ability (COCO Human Parts数据集泛化能力)

- 5.3 Hier R-CNN网络性能

- (1) 实现细节

- (2)Ablation Study

- (3)Comparison With Other Methods

- (4)Analysis and Discussion

论文链接:https://ieeexplore.ieee.org/stamp/stamp.jsp?tp=&arnumber=9229236

论文代码:https://github.com/soeaver/Hier-R-CNN

论文出处:IEEE Transactions on Image Processing,2020.

摘要

- 在实例级检测人体部位(Detecting human parts at instance-level)是分析人体关键点、动作和属性的必要前提。

- 尽管如此,目前还缺乏大规模的、注释丰富的人体部位检测数据集。

- 我们通过COCO Human Parts来填补这一空白。该数据集基于COCO 2017,是首个实例级人体部位数据集,包含复杂场景和高度多样性的图像。

- 为了反映自然场景中人体的多样性,我们对人体部位进行了标注(a)用一个边界框来表示位置,(b)包括脸、头、手、脚在内的多种类型,(c)人与人体部位之间的隶属关系,(d)细粒度地分为右手/左手和左脚/右脚。

- 许多更高层次的应用和研究可以建立在COCO人体部件的基础上,如手势识别、脸/手关键点检测、视觉动作、人-物交互和虚拟现实。

- 该数据集包括66,808个图像中总共有268,030个人实例,并且2.83 parts/ person instance。

- 我们对我们的注释的准确性提供了统计分析。

- 此外,我们提出了一个强基线,用于在该数据集上以端到端方式在实例级检测人体部位,称为Hier(archy) R-CNN。

- 它是Mask R-CNN的一个简单而有效的扩展,可以检测每个人实例的人的部分,并预测它们之间的从属关系。

1. 简介

- Detecting human parts in instance-level是人类视觉理解中最重要的组成部分之一,近年来引起了越来越多的关注

- 人体部位的准确定位在手势识别、面部关键点检测、手部关键点检测、视觉动作、人物交互、虚拟现实等应用中起着至关重要的作用。

- 然而,在现实应用中,理解人体的各个部分仍然存在许多挑战。

- 人体部位检测缺乏大规模的、注释丰富的数据集。

- 此外,人与人体各部分之间的从属关系是未知的,我们无法确定检测到的人体各部分属于哪一个人。

- 为了解决上述缺点,我们提出了COCO Human Parts dataset,一个大型实例级人体部件检测数据集,具有丰富的注释和各种场景。

- COCO为每个人提供了bounding-box和instance mask,一些研究丰富了人实例的注释,如keypoint、densepose、human attributes和human visual actions。

- COCO Human Parts包含268,030人的实例超过66808个图像。

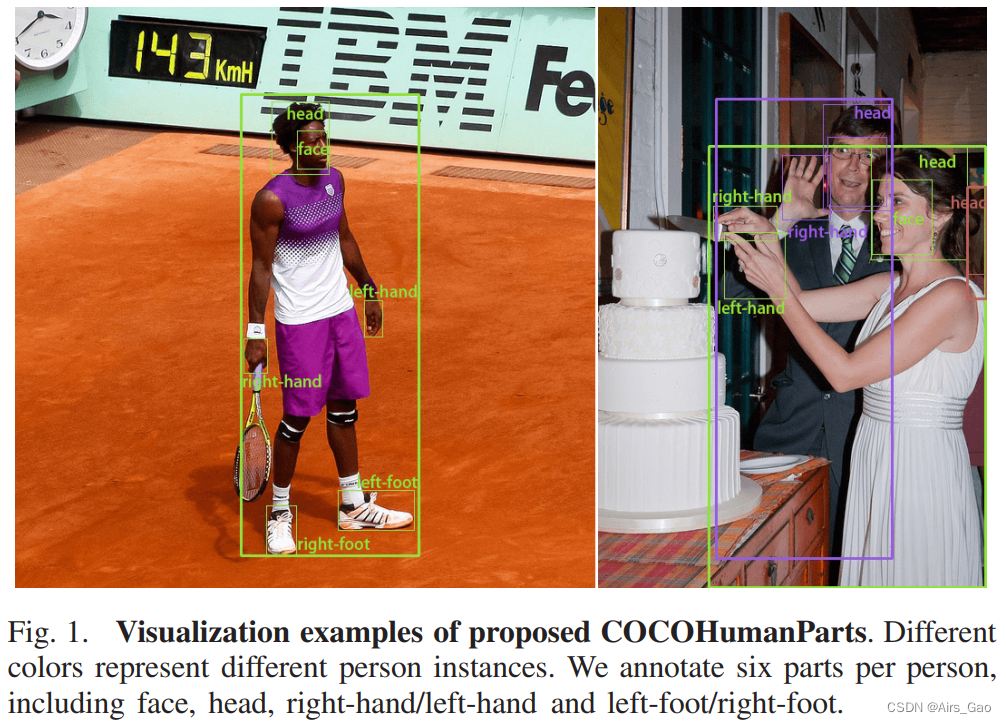

- 对于每个person实例,我们从官方COCO数据集继承person类别的边界框,并在每个实例中标记脸、头、右/左和右脚/左脚(如果是可见的)的位置(图1)。

- 总共有759,420个人体部位从训练和验证子集中被标记,并且每个实例2.83个部位,数据集中有各种比例变化和遮挡。

- 为了解决实例级的人体部位检测问题,我们注释了人体实例与人体部位之间的从属关系。

- 现在的目标检测器在几个主要的领域都取得了显著的成果,然而,如何同时检测个体实例及其他们的各部分,并预测它们之间的从属关系,仍然是一个挑战。 另一方面,人的实例与人的部分之间的尺度差距非常明显,这也是一个

本文来自互联网用户投稿,文章观点仅代表作者本人,不代表本站立场,不承担相关法律责任。如若转载,请注明出处。 如若内容造成侵权/违法违规/事实不符,请点击【内容举报】进行投诉反馈!