作业六:中文词频统计

作业要求来自: https://edu.cnblogs.com/campus/gzcc/GZCC-16SE2/homework/2773

1. 下载一长篇中文小说。

此处下载的是网络小说--全职高手

2. 从文件读取待分析文本。

3. 安装并使用jieba进行中文分词。

4. 更新词库,加入所分析对象的专业词汇。

5. 生成词频统计

6. 排序

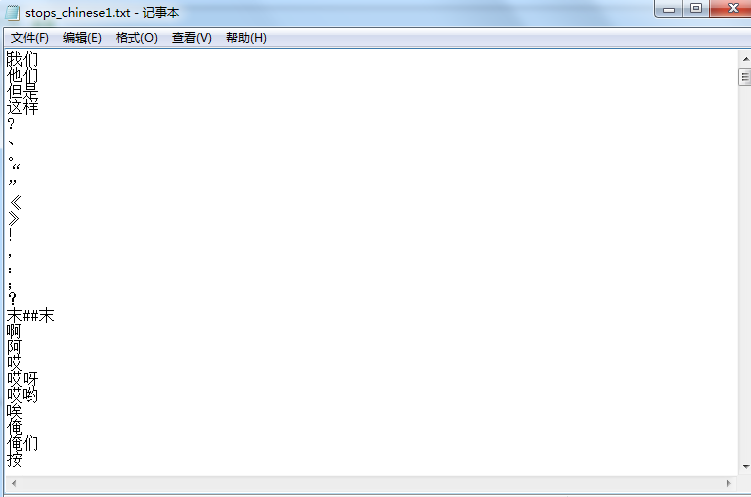

7. 排除语法型词汇,代词、冠词、连词等停用词。

此处使用的是标准的词语停用表:

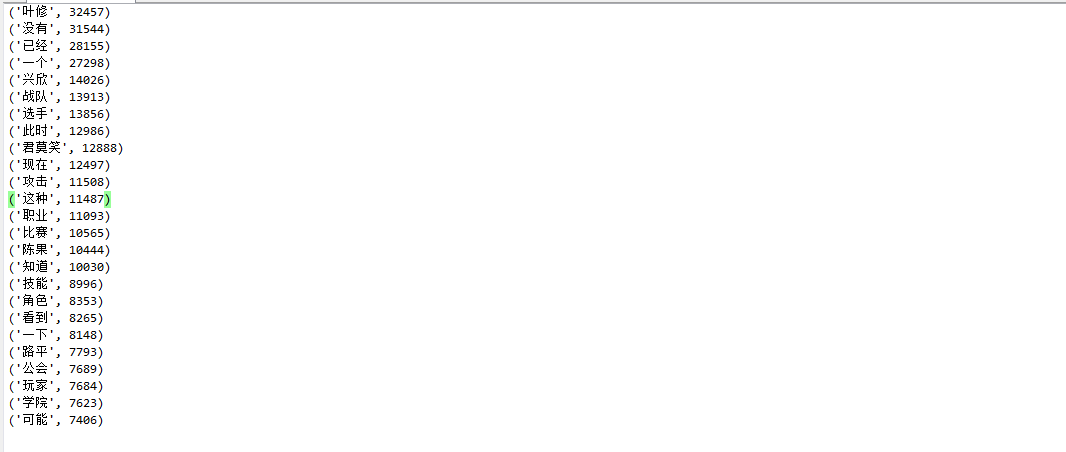

8. 输出词频最大TOP20,把结果存放到文件里

输出的top20为:

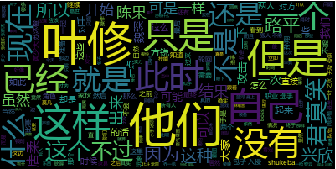

9. 生成词云。

生成的词云结果为:

源代码:

import jieba#导入jieba进行中文分词

from wordcloud import WordCloud#导入wordcloud进行词云的生成

import matplotlib.pyplot as plt

text=open('E://note.txt','r',encoding='utf-8').read()#打开并阅读需要进行处理的中文小说worddict1=open('D://ciyun.txt','r',encoding='utf-8').read()#打开并添加阅读词库worddict2=open('E://stops_chinese1.txt','r',encoding='utf-8').read()#打开并读取无意义的词语库wordsls=jieba.lcut(text)#利用jieba进行中文分词wcdict={}for word in wordsls:if word not in worddict2:if len(word)==1:continueelse:wcdict[word]=wcdict.get(word,0)+1wcls=list(wcdict.items())#进行词语的词频统计

wcls.sort(key=lambda x:x[1],reverse=True)#利用jieba进行中文分词for i in range(25):#输出词频前25的词语print(wcls[i])wl_split=" ".join(wordsls) #对要处理的中文小说进行空格隔开处理mywc = WordCloud().generate(wl_split)#生成词云plt.imshow(mywc)#显示词云

plt.axis("off")

plt.show()

转载于:https://www.cnblogs.com/wuguoliang/p/11045526.html

本文来自互联网用户投稿,文章观点仅代表作者本人,不代表本站立场,不承担相关法律责任。如若转载,请注明出处。 如若内容造成侵权/违法违规/事实不符,请点击【内容举报】进行投诉反馈!