西瓜书读书笔记整理(一)—— 如何使用本书、本书目录内容以及数学符号

个人导读:非常喜欢这部分内容,写在前言后、绪论前。喜欢的原因很简单 —— 使用说明书可以大大提高我们的阅读效率。我愿意称之为 “屠龙宝刀的使用秘籍”。

1.1 如何使用本书

作者在本章节说明两方面内容:这是一本什么书与怎么读这边书。

现在我们总结性地回答这两个问题。

这是一本什么书

- 这是一本教科书。每个章节的篇幅合理,详略得当;

- 这是一本 入门级 教科书。注重基础内容,概要大于明细,覆盖面广而不过深;

- 这是一本面向理工科高年级本科生与研究深的教科书。作为前沿学科的入门先导,读者需要深入了解时应当自行查找资料进一步学习。

怎么读这本书:多读几遍。

- 第一遍应当快速阅读,快速了解此门学科大体内容,细处不懂可以标记,直接略过;(建议一个月内理清楚)

- 第二遍仔细阅读,了解机器学习的疆域和基本思想,理解基本概念,回顾前面标记的问题;(建议三个月到半年时间)

- 第三遍回头再读,结合自己的工作经验再次理解。

结合我自己的理解,这与当初操作系统老师的建议很像:读教材书应该是一个先把书读薄,再把书读厚,最后再把书读薄的过程。第一遍总体把握,第二遍深入理解,第三遍概括总结,大有 “厚积薄发” 之意。

1.2 本书目录

这部分内容我根据我自己对各个章节的理解,进行快速地概括,总体内容如下:

| 章 | 节 | 重要性 | 内容概述 |

|---|---|---|---|

| 第1章 | 1. 绪论 | ⭐️⭐️⭐️⭐️ | 最基本的术语 |

| 1.1 引言 | ⭐️ | 从作者买西瓜的过程引入机器学习基本概念 | |

| 1.2 基本术语 | ⭐️⭐️⭐️⭐️⭐️ | 基本术语,必须牢记 | |

| 1.3 假设空间 | ⭐️⭐️⭐️⭐️⭐️ | 基本术语,必须牢记 | |

| 1.4 归纳偏好 | ⭐️⭐️⭐️⭐️⭐️ | 基本术语,必须牢记 | |

| 1.5 发展历程 | ⭐️⭐️ | 略读即可 | |

| 1.6 应用现状 | ⭐️ | 略读即可 | |

| 1.7 阅读材料 | ⭐️ | 略读即可 | |

| 第2章 | 2. 模型评估与选择 | ⭐️⭐️⭐️⭐️⭐️ | 基础内容,模型评估方法等 |

| 2.1 经验误差与过拟合 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 2.2 评估方法 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 2.3 性能度量 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 2.4 比较检验 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 2.5 偏差与方差 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 2.6 阅读材料 | ⭐️ | 略读即可 | |

| 第3章 | 3. 线性模型 | ⭐️⭐️⭐️⭐️⭐️ | 算法基础模型容易理解,初学者重点学习 |

| 3.1 基本形式 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 3.2 线性回归 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 3.3 对数几率回归 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 3.4 线性判别方法 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 3.5 多分类学习 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 3.6 类别不平衡问题 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 3.7 阅读材料 | ⭐️ | 略读即可 | |

| 第4章 | 4. 决策树 | ⭐️⭐️⭐️⭐️⭐️ | 面试问题重灾区 |

| 4.1 基本流程 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 4.2 划分选择 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 4.3 剪枝处理 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 4.4 连续与缺失值 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 4.5 多变量决策树 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 4.6 阅读材料 | ⭐️ | 略读即可 | |

| 第5章 | 5. 神经网络 | ⭐️⭐️⭐️ | 本书这方面介绍得较浅 |

| 5.1 神经元模型 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 5.2 感知机与多层网络 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 5.3 误差逆传播算法 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 5.4 全局最小与局部极小 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 5.5 其他常见神经网络 | ⭐️⭐️ | 理解与牢记 | |

| 5.6 深度学习 | ⭐️⭐️⭐️⭐️ | 细读理解 | |

| 5.7 阅读材料 | ⭐️ | 略读即可 | |

| 第6章 | 6. 支持向量机 | ⭐️⭐️⭐️⭐️⭐️ | 面试重灾区 |

| 6.1 间隔与支持向量 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 6.2 对偶问题 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 6.3 核函数 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 6.4 软间隔与正则化 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 6.5 支持向量回归 | ⭐️⭐️ | 理解与牢记 | |

| 6.6 核方法 | ⭐️⭐️⭐️⭐️ | 细读理解 | |

| 6.7 阅读材料 | ⭐️ | 略读即可 | |

| 第7章 | 7. 贝叶斯分类器 | ⭐️⭐️⭐️⭐️⭐️ | 数学基础要求相对较高 |

| 7.1 贝叶斯决策论 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 7.2 极大似然估计 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记(与深度学习算法联系) | |

| 7.3 朴素贝叶斯分类器 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记(这个是最常用的) | |

| 7.4 半朴素贝叶斯分类器 | ⭐️⭐️⭐️ | 理解与牢记 | |

| 7.5 贝叶斯网络 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 7.6 EM算法 | ⭐️⭐️⭐️⭐️⭐️ | 细读理解 | |

| 7.7 阅读材料 | ⭐️ | 略读即可 | |

| 第8章 | 8. 集成学习 | ⭐️⭐️⭐️⭐️⭐️ | 比赛常用此类算法 |

| 8.1 个体与集成 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 8.2 Boosting | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 8.3 Boosting与随机森林 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 8.4 结合性策略 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 8.5 多样性 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 8.6 阅读材料 | ⭐️ | 略读即可 | |

| 补充 xgboost / lightGBM原理与常见面试题 | 面试重灾区 | ||

| 第9章 | 9. 聚类 | ⭐️⭐️⭐️⭐️ | 分类、区分以及核心原理 |

| 9.1 聚类任务 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 9.2 性能度量 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 9.3 距离计算 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 9.4 原型聚类 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 9.5 密度聚类 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 9.6 层次聚类 | ⭐️⭐️⭐️⭐️ | 略读即可 | |

| 9.7 阅读材料 | ⭐️ | 略读即可 | |

| 第10章 | 10. 降维与度量方法 | ⭐️⭐️⭐️ | 理解牢记几个知识点 |

| 10.1 k近邻学习 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 10.2 低维嵌入 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 10.3 主成分分析 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 10.4 核化线性降维 | ⭐️⭐️⭐️ | 理解 | |

| 10.5 流形学习 | ⭐️⭐️⭐️ | 理解 | |

| 10.6 度量学习 | ⭐️⭐️⭐️ | 理解 | |

| 10.7 阅读材料 | ⭐️ | 略读即可 | |

| 第11章 | 11. 特征选择与稀疏学习 | ⭐️⭐️⭐️⭐️⭐️ | 理解牢记几个知识点 |

| 11.1 子集搜索与评价 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 11.2 过滤式选择 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 11.3 包裹式选择 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 11.4 嵌入式选择与L1正则化 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 11.5 稀疏表示与字典学习 | ⭐️⭐️⭐️ | 理解 | |

| 11.6 压缩感知 | ⭐️⭐️⭐️ | 理解 | |

| 11.7 阅读材料 | ⭐️ | 略读即可 | |

| 第12章 | 12. 计算学习理论 | ⭐️⭐️⭐️⭐️⭐️ | 理解牢记几个知识点 |

| 12.1 基础知识 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 12.2 PAC学习 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 12.3 有限假设空间 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 12.4 VC维 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 12.5 Rademacher负责度 | ⭐️⭐️⭐️ | 理解 | |

| 12.6 稳定性 | ⭐️⭐️⭐️ | 理解 | |

| 12.7 阅读材料 | ⭐️ | 略读即可 | |

| 第13章 | 13. 半监督学习 | ⭐️⭐️⭐️⭐️⭐️ | 理解牢记几个知识点 |

| 13.1 未标记样本 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 13.2 生成式方法 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 13.3 半监督SVM | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 13.4 图半监督学习 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 13.5 基于分歧的方法 | ⭐️⭐️⭐️ | 理解 | |

| 13.6 半监督聚类 | ⭐️⭐️⭐️ | 理解 | |

| 13.7 阅读材料 | ⭐️ | 略读即可 | |

| 第14章 | 14. 概率图模型 | ⭐️⭐️⭐️⭐️⭐️ | 理解牢记几个知识点 |

| 14.1 隐马尔可夫模型 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 14.2 马尔可夫随机场 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 14.3 条件随机场 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 14.4 学习与推断 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 14.5 近似推断 | ⭐️⭐️⭐️ | 理解 | |

| 14.6 话题模型 | ⭐️⭐️⭐️ | 理解 | |

| 14.7 阅读材料 | ⭐️ | 略读即可 | |

| 第15章 | 15. 规则学习 | ⭐️⭐️⭐️⭐️⭐️ | 理解牢记几个知识点 |

| 15.1 基本概念 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 15. 2 序贯覆盖 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 15.3 剪枝优化 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 15.4 一阶规则学习 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 15.5 归纳逻辑程序设计 | ⭐️⭐️⭐️ | 理解 | |

| 15.6 阅读材料 | ⭐️ | 略读即可 | |

| 第16章 | 16. 强化学习 | ⭐️⭐️⭐️⭐️⭐️ | 本书介绍较浅 |

| 16.1 任务与奖赏 | ⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 16. 2 K-摇臂赌博机 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 16.3 有模型学习 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 16.4 免模型学习 | ⭐️⭐️⭐️⭐️⭐️ | 理解与牢记 | |

| 16.5 值函数近似 | ⭐️⭐️⭐️ | 理解 | |

| 16.6 模仿学习 | ⭐️⭐️⭐️ | 理解 | |

| 15.7 阅读材料 | ⭐️ | 略读即可 |

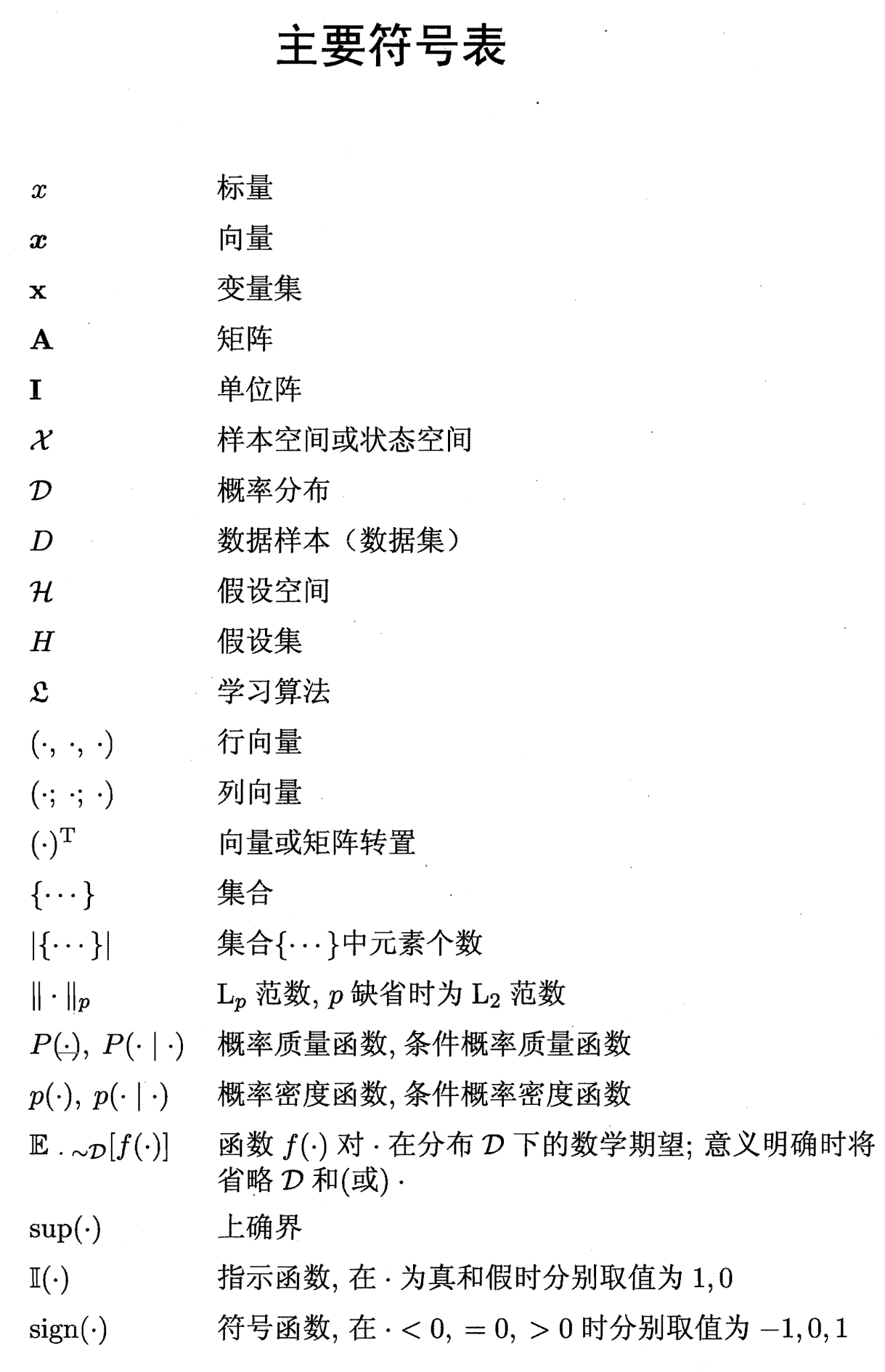

1.3 数学符号

1.3.1 数和数组

| 符号 | 书写 | 含义 |

|---|---|---|

| a a a | $a$ | 标量(整数或实数) |

| a \boldsymbol{a} a | $\boldsymbol{a}$ | 向量 |

| A \boldsymbol{A} A | $\boldsymbol{A}$ | 矩阵 |

| A \mathbf{A} A | $\mathbf{A}$ | 张量 |

| I n \boldsymbol{I_n} In | $\boldsymbol{I_n}$ | n行n列的单位矩阵 |

| I \boldsymbol{I} I | $\boldsymbol{I}$ | 单位矩阵 |

| e ( i ) e^{(i)} e(i) | $e^{(i)}$ | 标准基向量 |

| d i a g ( a ) diag(\boldsymbol{a}) diag(a) | $diag($\boldsymbol{a}$) | 对角矩阵 |

| a \mathrm{a} a | $\mathrm{a}$ | 标量随机变量 |

| a \mathbf{a} a | $\mathbf{a}$ | 向量随机变量 |

| A \mathbf{A} A | $\mathbf{A}$ | 矩阵随机变量 |

1.3.2 集合和图

| 符号 | 书写 | 含义 |

|---|---|---|

| A \mathbb{A} A | $\mathbb{A}$ | 集合 |

| R \mathbb{R} R | $\mathbb{R}$ | 实数集 |

| { 0 , 1 } \{0,1\} {0,1} | $\{0,1\}$ | 集合 |

| { 0 , 1 , . . . , n } \{0,1,...,n\} {0,1,...,n} | $\{0,1,…,n\}$ | 集合 |

| [ a , b ] [a, b] [a,b] | $[a, b]$ | 区间 |

| [ a , b ) [a,b) [a,b) | $[a,b)$ | 区间 |

| A \mathbb{A} A \ B \mathbb{B} B | $\mathbb{A}$ \ $\mathbb{B}$ | 差集 |

| G \mathcal{G} G | $\mathcal{G}$ | 图 |

| P a G ( x i ) Pa_\mathcal{G}(x_i) PaG(xi) | $Pa_\mathcal{G}(x_i)$ | 图的父节点 |

| a i a_i ai | $a_i$ | 向量a的第i个元素 |

| $a_{-i}$ | $a_{-i}$ | 除了第i个其他元素 |

| A i , j \boldsymbol{A_{i,j}} Ai,j | $\boldsymbol{A_{i,j}}$ | 矩阵A的(i,j)元素 |

| A i , : \boldsymbol{A_{i,:}} Ai,: | $\boldsymbol{A_{i,:}}$ | 矩阵A第i行 |

| A : , j \boldsymbol{A_{:,j}} A:,j | $\boldsymbol{A_{:,j}}$ | 矩阵A第j列 |

| A i , j , k \boldsymbol{A_{i,j,k}} Ai,j,k | $\boldsymbol{A_{i,j,k}}$ | 3维矩阵A的(i,j,k)元素 |

| A : , : , k \boldsymbol{A_{:,:,k}} A:,:,k | $\boldsymbol{A_{:,:,k}}$ | 3维矩阵的2维切面 |

| a i \mathrm{a}_i ai | $\mathrm{a}_i$ | 随机向量a的第i个元素 |

1.3.3 线性代数

| 符号 | 书写 | 含义 |

|---|---|---|

| A T \boldsymbol{A}^T AT | $\boldsymbol{A}^T$ | 矩阵A的转置 |

| A + \boldsymbol{A}^+ A+ | $\boldsymbol{A}^+$ | A的Moore-Penrose伪逆 |

| A ⊙ B \boldsymbol{A}\odot\boldsymbol{B} A⊙B | $\boldsymbol{A}\odot\boldsymbol{B}$ | A和B的逐元素乘积 |

| det( A \boldsymbol{A} A) | det($\boldsymbol{A}$) | A的行列式 |

1.3.4 微积分

| 符号 | 书写 | 含义 |

|---|---|---|

| d y d x \frac{dy}{dx} dxdy | $\frac{dy}{dx}$ | y关于x的导数 |

| ∂ y ∂ x \frac{\partial y}{\partial x} ∂x∂y | $\frac{\partial y}{\partial x}$ | y关于x的偏导 |

| ∇ x y \nabla_x y ∇xy | $\nabla_x y$ | y关于x的梯度 |

| ∇ X y \nabla_{\boldsymbol{X}} \ y ∇X y | $\nabla_{\boldsymbol{X}} \ y$ | y关于X的矩阵导数 |

| ∇ X y \nabla_{\mathbf{X}} \ y ∇X y | $\nabla_{\mathbf{X}} \ y$ | y关于X求导后的张量 |

| ∂ f ∂ x \frac{\partial f}{\partial x} ∂x∂f | $\frac{\partial f}{\partial x}$ | f : R n → R m f:\mathbb{R}^n\rightarrow \mathbb{R}^m f:Rn→Rm 的 Jacobian矩阵 J ∈ R m × n J\in \mathbb{R}^{m\times n} J∈Rm×n |

| ∇ x 2 f ( x ) \nabla^2_{\boldsymbol{x}} \ f(x) ∇x2 f(x) 或 H ( f ) ( x ) H(f)(x) H(f)(x) | $\nabla^2_{\boldsymbol{x}} \ f(x)$ | f 在点 x 处的 Hessian 矩阵 |

| ∫ f ( x ) d x \int{f(x)dx} ∫f(x)dx | $\int{f(x)dx}$ | x在整个域上的积分 |

| ∫ S f ( x ) d x \int_{\mathbb{S}}{f(x)dx} ∫Sf(x)dx | $\int_{\mathbb{S}}{f(x)dx}$ | 集合 S 上关于 x 的积分 |

1.3.5 概率和信息论

| 符号 | 书写 | 含义 |

|---|---|---|

| a ⊥ b a\bot b a⊥b | $a\bot b$ | a和b相互独立的随机变量 |

| $a\bot b\ | \ c$ | $a\bot b\ |\ c$ |

| P ( a ) P(a) P(a) | $P(a)$ | 随机变量上的概率分布 |

| p ( a ) p(a) p(a) | $p(a)$ | 连续变量上的概率分布 |

| $a \sim P $ | $a \sim P$ | 具有分布P的随机变量a |

| E x ∼ P [ f ( x ) ] \mathbb{E}_{x \sim P[f(x)]} Ex∼P[f(x)] or E f ( x ) \mathbb{E}f(x) Ef(x) | $\mathbb{E}_{x \sim P[f(x)]}$ | f(x) 关于P(x) 的期望 |

| V a r ( f ( x ) Var(f(x) Var(f(x)) | $Var(f(x))$ | f(x) 关于分布P(x) 下的方差 |

| C o v ( f ( x ) , g ( x ) ) Cov(f(x),g(x)) Cov(f(x),g(x)) | $Cov(f(x),g(x))$ | f(x) 和 g(x) 的协方差 P() |

| H ( x ) H(x) H(x) | $H(x)$ | 随机变量 x 的香农熵 |

| $D_{KL}(P | Q)$ | |

| N ( x ; μ , ∑ ) \mathcal{N}(x;\mu,\sum) N(x;μ,∑) | $\mathcal{N}(x;\mu,\sum)$ | x 在均值为 μ \mu μ ,协方差为 ∑ \sum ∑ 上的高斯分布 |

1.3.6 函数

| 符号 | 书写 | 含义 |

|---|---|---|

| f : A → B f:\mathbb{A}\rightarrow\mathbb{B} f:A→B | $f:\mathbb{A}\rightarrow\mathbb{B}$ | 定义域为 A \mathbb{A} A 值域为 B \mathbb{B} B 的函数 f |

| f ∘ g f \circ g f∘g | $f \circ g$ | f 和 g 的组合 |

| f ( x ; θ ) f(x;\theta) f(x;θ) | $f(x;\theta)$ | 含参数 θ \theta θ 的函数 |

| log x \log x logx | $\log x$ | x 的自然对数 |

| σ ( x ) \sigma(x) σ(x) | $\sigma(x)$ | Logistic sigmoid, 1 1 − e x p ( − x ) \frac{1}{1-exp(-x)} 1−exp(−x)1 |

| ζ ( x ) \zeta(x) ζ(x) | $\zeta(x)$ | Softplus, log ( 1 + e x p ( x ) ) \log (1+exp(x)) log(1+exp(x)) |

| $ | x | |

| $ | x | |

| x + x^+ x+ | $x^+$ | x x x 的正数部分, m a x ( 0 , x ) max(0,x) max(0,x) |

| 1 c o n d i t i o n 1_{condition} 1condition | $1_{condition}$ | 如果条件为真则为1 |

1.3.7 数据集和分布

| 符号 | 书写 | 含义 |

|---|---|---|

| p d a t a p_{data} pdata | $p_{data}$ | 数据生成分布 |

| p ^ t r a i n \hat{p}_{train} p^train | $\hat{p}_{train}$ | 由训练集定义的经验分布 |

| X \mathbb{X} X | $\mathbb{X}$ | 训练样本的集合 |

| x ( i ) x^{(i)} x(i) | $x^{(i)}$ | 数据集的第i个样本 |

| y ( i ) y^{(i)} y(i) | $y^{(i)}$ | 监督学习中的标签 |

1.3.8 西瓜书主要符号表

拥护正版书籍

以下内容为本人购买记录:

14 本章总结

首先快速浏览这本书,对每个章节有个初步的了解,不停地问自己一个问题:这一章讲的是什么,这一节讲的是什么,如果我是技术面试官,我会问面试者什么样的问题。

共勉 !

Smileyan

2023.04.01 09:05

本文来自互联网用户投稿,文章观点仅代表作者本人,不代表本站立场,不承担相关法律责任。如若转载,请注明出处。 如若内容造成侵权/违法违规/事实不符,请点击【内容举报】进行投诉反馈!