大模型微调技术——LoRA

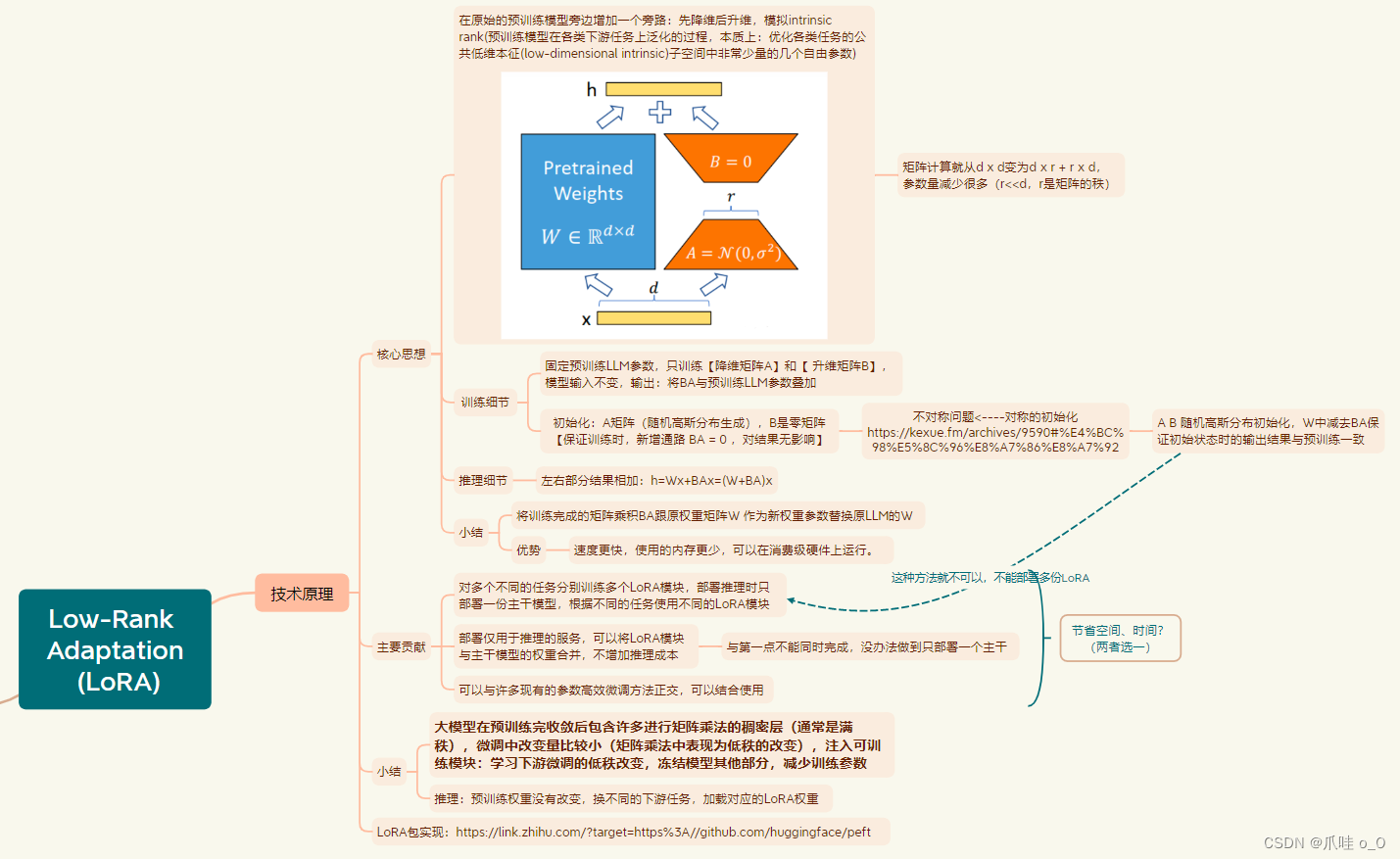

LoRA作为大模型微调技术一颗耀眼的珍珠,我称之为极简主义的美学。相比P-tuning系列的微调技术的繁杂,LoRA以极简的数学思想却十分成效的结果,在大模型微调技术中站住了重要的一席之地。因此,原理上理解LoRA并不复杂。作为整个系列的最后一更,LoRA也是作为压轴的但是却是整理内容部分最少的存在,却也不影响我对它的偏爱。

大模型微调技术系列原理:

大模型微调技术——概述

大模型微调技术——LoRA

大模型微调技术——Prefix Tuning 与 Prompt Tuning总结

大模型微调技术——P-Tuning及P-Tuning v2总结

本文来自互联网用户投稿,文章观点仅代表作者本人,不代表本站立场,不承担相关法律责任。如若转载,请注明出处。 如若内容造成侵权/违法违规/事实不符,请点击【内容举报】进行投诉反馈!