深度学习logits是什么?

什么是logtis?

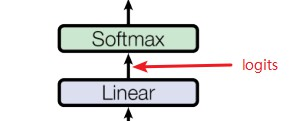

在深度学习的上下文中,logits 就是一个向量,下一步通常被投给 softmax/sigmoid 的向量。。

softmax的输出是分类任务的概率,其输入是logits层。 logits层通常产生-infinity到+ infinity的值,而softmax层将其转换为0到1的值。

举个例子:

- 如果一个二分类模型的输出层是一个单节点,没有激活函数,输出值是2.5。则2.5就是这个样本被预测为正类的logits。

- 如果一个多分类模型的输出层是5个节点,没有激活函数,输出值是[1.2, 3.1, -0.5, 4.8, 2.3]。则这个向量表示该样本属于5个类别的logits。

logits可以取任意实数值,正值表示趋向于分类到该类,负值表示趋向于不分类到该类。与之对应,probability经过softmax/sigmoid归一化到0-1之间,表示属于该类的概率。

logtis在交叉熵损失中的示例:

logtis可以看作神经网络输出的未经过归一化(softmax/sigmoid)的概率,所以将其结果用于分类任务计算loss时,如求cross_entropy的loss函数会设置from_logits参数。

因此,当from_logtis=False(默认情况)时,可以理解为输入的y_pre不是来自logtis,那么它就是已经经过softmax或者sigmoid归一化后的结果了;当from_logtis=True时,则可以理解为输入的y_pre是logits,那么需要对它进行softmax或者sigmoid处理再计算cross entropy。

如下面的两种方式计算得到的loss都是一样的:

import torch

import torch.nn as nn

import torch.nn.functional as Ffrom_logits = True # 标记logtis or sigmoid

y_pre = torch.FloatTensor([[5, 5], [2, 8]]) # logtis值:神经网络的输出,未概率归一化

y_true = torch.FloatTensor([[1, 0], [0, 1]]) # 真实的二分类标签if from_logits == True:# BCEWithLogitsLoss可以直接对logtis值进行二分类的损失计算criterion = nn.BCEWithLogitsLoss()loss = criterion(y_pre, y_true)

else:# BCELoss需要对logtis值进行概率归一化,然后再进行二分类的损失计算criterion = nn.BCELoss()y_pre = F.sigmoid(y_pre)loss = criterion(y_pre, y_true)

print(loss)

神经网络中的logits是什么意思_五月的天气的博客-CSDN博客

本文来自互联网用户投稿,文章观点仅代表作者本人,不代表本站立场,不承担相关法律责任。如若转载,请注明出处。 如若内容造成侵权/违法违规/事实不符,请点击【内容举报】进行投诉反馈!