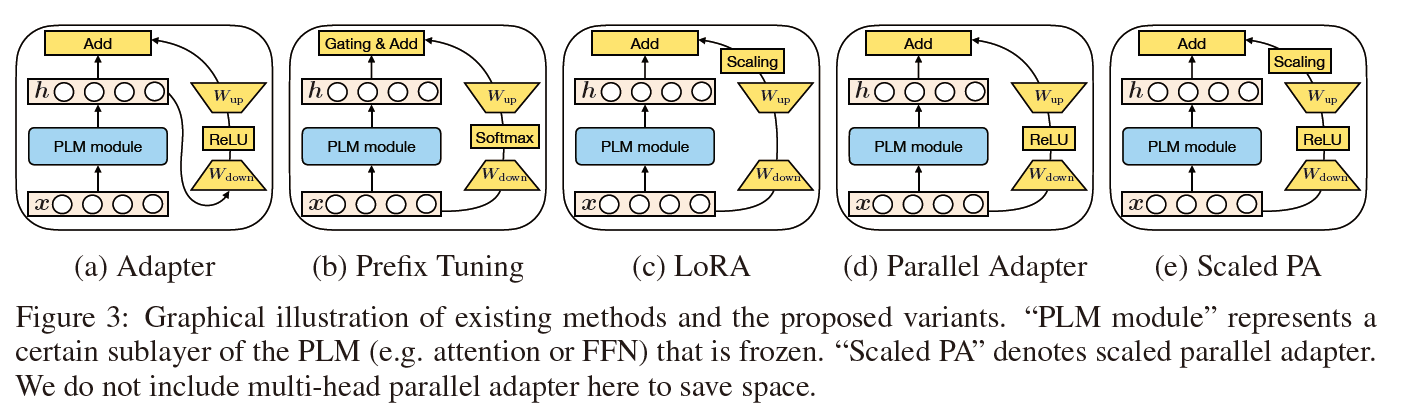

大模型-DeltaTuning:①增量式(原模型参数不变,插入可微调参数层)、②指定式(原模型参数冻结一部分参数,微调一部分参数)、③重参数化式(将原模型参数层改造,比如插入低秩)

【随着模型增大,各方案区别不大】

统一框架: 《Towards a Unified View of Parameter-Efficient Transfer Learning》

GitHub - thunlp/PromptPapers: Must-read papers on prompt-based tuning for pre-trained language models.

GitHub - thunlp/DeltaPapers: M

本文来自互联网用户投稿,文章观点仅代表作者本人,不代表本站立场,不承担相关法律责任。如若转载,请注明出处。 如若内容造成侵权/违法违规/事实不符,请点击【内容举报】进行投诉反馈!