【渗透测试】VulnHub-Lampiao

VulnHub-Lampiao渗透

- VulnHub-Lampiao详细解题步骤

- 知识点总结

- 一、Linux中查看进程状态信息命令:ps

- 二、CVE-2018-7600——Drupal

- 三、dirtycow脏牛提权

- 四、Python SimpleHTTPServer:

- 五、linux远程下载文件到本地

- scp

- ftp

- wget

- 六、GCC编译

- 常用工具篇

- 一、Dirb:Kali Linux下web网站目录爆破工具

- 二、cewl:密码攻击工具

- 三、wget:Linux下载文件的工具

VulnHub-Lampiao详细解题步骤

VulnHub-Lampiao详细解题步骤

nmap找目标ip,开放端口信息:22(ssh),1898(找到drupal漏洞)

web页面找漏洞,扫目录,dirb爆破扫描

利用cewl&hydra进行暴力攻击,获取低权限用户密码

找到Drupal漏洞CVE-2018-7600提权

利用msf设置目标ip和端口,获取shell

利用dirtycow脏牛找到目标文件(,cpp),cp复制到本地

开启端口,开启本地python服务

使用wget将目标文件存到靶机上

gcc编译该可执行文件,拿到root密码,拿到flag

知识点总结

一、Linux中查看进程状态信息命令:ps

-

ps -ef |grep 加要查找进程的东西:PS是LINUX下最常用的也是非常强大的进程查看命令

grep命令 是查找, 是一种强大的文本搜索工具,它能 搜索文本,并把匹 配的行打印出来。

grep全称是Global Regular Expression Print,表示全局正则表达式版本,它的使用权限是所有用户。

PID //进程的ID PPID //父进程ID C //进程占用CPU的百分比 STIME //进程启动到现在的时间 TTY //该进程在那个终端上运行,若与终端无关,则显示? 若为pts/0等,则表示由网络连接主机进程。 CMD //命令的名称和参数``` -

ps aux:用BSD的格式来显示同ps -ef 不同的有列有

%CPU //进程占用的CPU百分比 %MEM //占用内存的百分比 VSZ //该进程使用的虚拟內存量(KB) RSS //该进程占用的固定內存量(KB)(驻留中页的数量) STAT //进程的状态 START //该进程被触发启动时间 TIME //该进程实际使用CPU运行的时间```

二、CVE-2018-7600——Drupal

远程代码执行漏洞

Drupal是使用PHP语言编写的开源内容管理框架(CMF),它由**内容管理系统(CMS)和PHP开发框架(Framework)**共同构成

https://paper.seebug.org/567/

http://blog.nsfocus.net/cve-2018-7600-analysis/

Durpal 7版本2016年可以使用dirty(脏牛)进行提权

三、dirtycow脏牛提权

Durpal 7版本2016年可以使用dirty(脏牛)进行提权

https://blog.csdn.net/hbhgyu/article/details/106245182

Linux内核的内存子系统在处理copy-on-write(COW)时出现竞争条件,导致私有只读存储器映射被破坏,可利用此漏洞非法获得读写权限,进而提升权限。

漏洞成因:写时复制的竞态条件

写时复制是一种允许不同进程中的虚拟内存映射到相同物理内存页面的技术

竞态条件是指一个系统或者进程的输出依赖于不受控制的事件出现顺序或者出现时机

四、Python SimpleHTTPServer:

python -m SimpleHTTPServer #python2中启动一个简单的http服务器

python -m http.server #python3中启动一个简单的http服务器

五、linux远程下载文件到本地

scp

Linux scp 命令用于 Linux 之间复制文件和目录。

Linux 系统下基于 ssh 登陆进行安全的远程文件拷贝命令。

scp 是加密的,rcp 是不加密的,scp 是 rcp 的加强版。

-

语法:

scp [可选参数] file_source file_target -

参数说明:

- -1: 强制scp命令使用协议ssh1

- -2: 强制scp命令使用协议ssh2

- -4: 强制scp命令只使用IPv4寻址

- -6: 强制scp命令只使用IPv6寻址

- -B: 使用批处理模式(传输过程中不询问传输口令或短语)

- -C: 允许压缩。(将-C标志传递给ssh,从而打开压缩功能)

- -p:保留原文件的修改时间,访问时间和访问权限。

- -q: 不显示传输进度条。

- -r: 递归复制整个目录。

- -v:详细方式显示输出。scp和ssh(1)会显示出整个过程的调试信息。这些信息用于调试连接,验证和配置问题。

- -c cipher: 以cipher将数据传输进行加密,这个选项将直接传递给ssh。

- -F ssh_config: 指定一个替代的ssh配置文件,此参数直接传递给ssh。

- -i identity_file: 从指定文件中读取传输时使用的密钥文件,此参数直接传递给ssh。

- -l limit: 限定用户所能使用的带宽,以Kbit/s为单位。

- -o ssh_option: 如果习惯于使用ssh_config(5)中的参数传递方式,

- -P port:注意是大写的P, port是指定数据传输用到的端口号

- -S program: 指定加密传输时所使用的程序。此程序必须能够理解ssh(1)的选项。

1、从本地复制到远程

命令格式:

①scp local_file remote_username@remote_ip:remote_folder

Eg:scp /home/space/music/1.mp3 root@www.runoob.com:/home/root/others/music ②scp local_file remote_username@remote_ip:remote_file

Eg:scp /home/space/music/1.mp3 root@www.runoob.com:/home/root/others/music/001.mp3 第1,2个指定了用户名,命令执行后需要再输入密码,第1个仅指定了远程的目录,文件名字不变,第2个指定了文件名; ③scp local_file remote_ip:remote_folder

Eg:scp /home/space/music/1.mp3 www.runoob.com:/home/root/others/music ④scp local_file remote_ip:remote_file

Eg:scp /home/space/music/1.mp3 www.runoob.com:/home/root/others/music/001.mp3 第3,4个没有指定用户名,命令执行后需要输入用户名和密码,第3个仅指定了远程的目录,文件名字不变,第4个指定了文件名

复制目录命令格式:

①scp -r local_folder remote_username@remote_ip:remote_folder

Eg:scp -r /home/space/music/ root@www.runoob.com:/home/root/others/ //指定了用户名,命令执行后需要再输入密码;②scp -r local_folder remote_ip:remote_folder

Eg:scp -r /home/space/music/ www.runoob.com:/home/root/others/ //没有指定用户名,命令执行后需要输入用户名和密码;

上面命令将本地 music 目录复制到远程 others 目录下。

2、从远程复制到本地

从远程复制到本地,只要将从本地复制到远程的命令的后2个参数调换顺序即可,如下实例

应用实例:

scp root@www.runoob.com:/home/root/others/music /home/space/music/1.mp3

scp -r www.runoob.com:/home/root/others/ /home/space/music/

说明

1.如果远程服务器防火墙有为scp命令设置了指定的端口,我们需要使用 -P 参数来设置命令的端口号,命令格式如下:

#scp 命令使用端口号 4588

scp -P 4588 remote@www.runoob.com:/usr/local/sin.sh /home/administrator

2.使用scp命令要确保使用的用户具有可读取远程服务器相应文件的权限,否则scp命令是无法起作用的。

ftp

-

连接ftp服务器

格式:ftp [hostname| ip-address]

a)在linux命令行下输入:ftp 192.168.26.66

b)服务器询问你用户名和口令,分别输入用户名和相应密码,待认证通过即可。 -

下载文件

- get:

格式:get [remote-file] [local-file]

将文件从远端主机中传送至本地主机中.

如要获取服务器上e:\rose\1.bmp,则

ftp> get /rose/1.bmp 1.bmp (回车)- mget:

格式:mget [remote-files]

从远端主机接收一批文件至本地主机.

如要获取服务器上e:\rose\下的所有文件,则

ftp> cd /rose

ftp> mget . (回车)

wget

1.命令格式:

wget [参数] [URL地址]

2.命令功能:

1)支持断点下传功能;这一点,也是网络蚂蚁和FlashGet当年最大的卖点,现在,Wget也可以使用此功能,那些网络不是太好的用户可以放心了;

2)同时支持FTP和HTTP下载方式;尽管现在大部分软件可以使用HTTP方式下载,但是,有些时候,仍然需要使用FTP方式下载软件;

3)支持代理服务器;对安全强度很高的系统而言,一般不会将自己的系统直接暴露在互联网上,所以,支持代理是下载软件必须有的功能;

以下常用工具篇具体介绍

六、GCC编译

命令:g++ -Wall -pedantic -O2 -std=c++11 -pthread -o 40847 40847.cpp -lutil

\1. -Wall 一般使用该选项,允许发出GCC能够提供的所有有用的警告

\2. -pedantic 允许发出ANSI/ISO C标准所列出的所有警告

\3. -O2编译器的优化选项的4个级别,-O0表示没有优化,-O1为缺省值,-O3优化级别最高

\4. -std=c++11就是用按C++2011标准来编译的

\5. -pthread 在Linux中要用到多线程时,需要链接pthread库

\6. -o dcow gcc生成的目标文件,名字为dcow

执行gcc编译可执行文件,可直接提权。

常用工具篇

一、Dirb:Kali Linux下web网站目录爆破工具

(kali自带的字典)

big.txt #大的字典

small.txt #小的字典

catala.txt #项目配置字典

common.txt #公共字典

euskera.txt #数据目录字典

extensions_common.txt #常用文件扩展名字典

indexes.txt #首页字典

mutations_common.txt #备份扩展名

spanish.txt #方法名或库目录

others #扩展目录,默认用户名等

stress #压力测试

vulns #漏洞测试

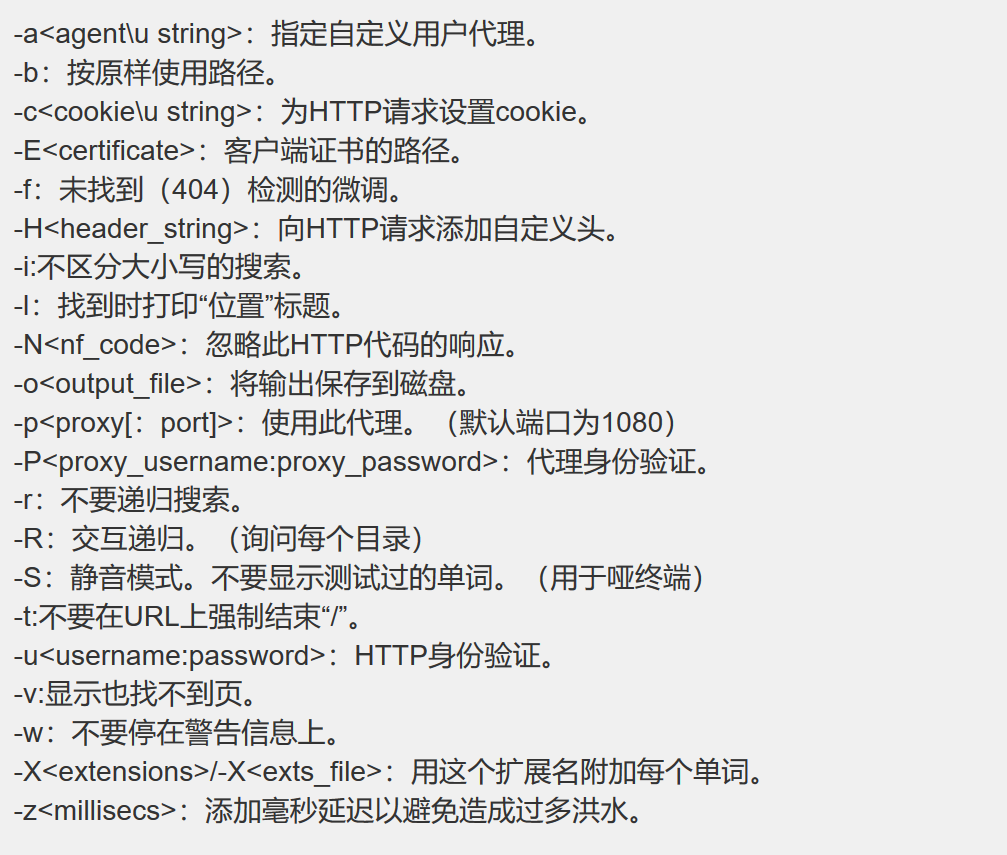

二、cewl:密码攻击工具

通过爬行网站获取关键信息创建一个密码字典。

官网:http://digi.ninja/projects/cewl.php

命令如下:

cewl 1.1.1.1 -m 3 -d 3 -e -c -v -w a.txt (1.1.1.1可以是目标网站的ip地址,也可以是网址)

-m:最小单词长度

-d:爬网深度

-e:收集包含emali地址信息

-c:每个单词出现的次数

支持基本,摘要,身份验证

支持代理;

CEWL可以和Hydra结合使用,一个获取字典,另一个暴力破解

三、wget:Linux下载文件的工具

- 可下载软件或从远程服务器恢复备份到本地服务器。

- 支持HTTP,HTTPS和FTP协议,可以使用HTTP代理。

- 可自动下载:可以在用户退出系统的之后在后台执行。这意味这你可以登录系统,启动一个wget下载任务,然后退出系统,wget将在后台执行直到任务完成

- 可以跟踪HTML页面上的链接依次下载来创建远程服务器的本地版本,完全重建原始站点的目录结构。这又常被称作”递归下载”。

用法: wget [选项]... [URL]...启动:-V, --version 显示 Wget 的版本信息并退出。-h, --help 打印此帮助。-b, --background 启动后转入后台。-e, --execute=COMMAND 运行一个“.wgetrc”风格的命令。日志和输入文件:-o, --output-file=FILE 将日志信息写入 FILE。-a, --append-output=FILE 将信息添加至 FILE。-d, --debug 打印大量调试信息。-q, --quiet 安静模式 (无信息输出)。-v, --verbose 详尽的输出 (此为默认值)。-nv, --no-verbose 关闭详尽输出,但不进入安静模式。--report-speed=TYPE Output bandwidth as TYPE. TYPE can be bits.-i, --input-file=FILE 下载本地或外部 FILE 中的 URLs。-F, --force-html 把输入文件当成 HTML 文件。-B, --base=URL 解析与 URL 相关的HTML 输入文件 (由 -i -F 选项指定)。--config=FILE Specify config file to use.下载:-t, --tries=NUMBER 设置重试次数为 NUMBER (0 代表无限制)。--retry-connrefused 即使拒绝连接也是重试。-O, --output-document=FILE 将文档写入 FILE。-nc, --no-clobber skip downloads that would download toexisting files (overwriting them).-c, --continue 断点续传下载文件。--progress=TYPE 选择进度条类型。-N, --timestamping 只获取比本地文件新的文件。--no-use-server-timestamps 不用服务器上的时间戳来设置本地文件。-S, --server-response 打印服务器响应。--spider 不下载任何文件。-T, --timeout=SECONDS 将所有超时设为 SECONDS 秒。--dns-timeout=SECS 设置 DNS 查寻超时为 SECS 秒。--connect-timeout=SECS 设置连接超时为 SECS 秒。--read-timeout=SECS 设置读取超时为 SECS 秒。-w, --wait=SECONDS 等待间隔为 SECONDS 秒。--waitretry=SECONDS 在获取文件的重试期间等待 1..SECONDS 秒。--random-wait 获取多个文件时,每次随机等待间隔0.5*WAIT...1.5*WAIT 秒。--no-proxy 禁止使用代理。-Q, --quota=NUMBER 设置获取配额为 NUMBER 字节。--bind-address=ADDRESS 绑定至本地主机上的 ADDRESS (主机名或是 IP)。--limit-rate=RATE 限制下载速率为 RATE。--no-dns-cache 关闭 DNS 查寻缓存。--restrict-file-names=OS 限定文件名中的字符为 OS 允许的字符。--ignore-case 匹配文件/目录时忽略大小写。-4, --inet4-only 仅连接至 IPv4 地址。-6, --inet6-only 仅连接至 IPv6 地址。--prefer-family=FAMILY 首先连接至指定协议的地址FAMILY 为 IPv6,IPv4 或是 none。--user=USER 将 ftp 和 http 的用户名均设置为 USER。--password=PASS 将 ftp 和 http 的密码均设置为 PASS。--ask-password 提示输入密码。--no-iri 关闭 IRI 支持。--local-encoding=ENC IRI (国际化资源标识符) 使用 ENC 作为本地编码。--remote-encoding=ENC 使用 ENC 作为默认远程编码。--unlink remove file before clobber.目录:-nd, --no-directories 不创建目录。-x, --force-directories 强制创建目录。-nH, --no-host-directories 不要创建主目录。--protocol-directories 在目录中使用协议名称。-P, --directory-prefix=PREFIX 以 PREFIX/... 保存文件--cut-dirs=NUMBER 忽略远程目录中 NUMBER 个目录层。HTTP 选项:--http-user=USER 设置 http 用户名为 USER。--http-password=PASS 设置 http 密码为 PASS。--no-cache 不在服务器上缓存数据。--default-page=NAME 改变默认页(默认页通常是“index.html”)。-E, --adjust-extension 以合适的扩展名保存 HTML/CSS 文档。--ignore-length 忽略头部的‘Content-Length’区域。--header=STRING 在头部插入 STRING。--max-redirect 每页所允许的最大重定向。--proxy-user=USER 使用 USER 作为代理用户名。--proxy-password=PASS 使用 PASS 作为代理密码。--referer=URL 在 HTTP 请求头包含‘Referer: URL’。--save-headers 将 HTTP 头保存至文件。-U, --user-agent=AGENT 标识为 AGENT 而不是 Wget/VERSION。--no-http-keep-alive 禁用 HTTP keep-alive (永久连接)。--no-cookies 不使用 cookies。--load-cookies=FILE 会话开始前从 FILE 中载入 cookies。--save-cookies=FILE 会话结束后保存 cookies 至 FILE。--keep-session-cookies 载入并保存会话 (非永久) cookies。--post-data=STRING 使用 POST 方式;把 STRING 作为数据发送。--post-file=FILE 使用 POST 方式;发送 FILE 内容。--content-disposition 当选中本地文件名时允许 Content-Disposition 头部 (尚在实验)。--content-on-error output the received content on server errors.--auth-no-challenge 发送不含服务器询问的首次等待的基本 HTTP 验证信息。HTTPS (SSL/TLS) 选项:--secure-protocol=PR choose secure protocol, one of auto, SSLv2,SSLv3, TLSv1, TLSv1_1 and TLSv1_2.--no-check-certificate 不要验证服务器的证书。--certificate=FILE 客户端证书文件。--certificate-type=TYPE 客户端证书类型,PEM 或 DER。--private-key=FILE 私钥文件。--private-key-type=TYPE 私钥文件类型,PEM 或 DER。--ca-certificate=FILE 带有一组 CA 认证的文件。--ca-directory=DIR 保存 CA 认证的哈希列表的目录。--random-file=FILE 带有生成 SSL PRNG 的随机数据的文件。--egd-file=FILE 用于命名带有随机数据的 EGD 套接字的文件。FTP 选项:--ftp-user=USER 设置 ftp 用户名为 USER。--ftp-password=PASS 设置 ftp 密码为 PASS。--no-remove-listing 不要删除‘.listing’文件。--no-glob 不在 FTP 文件名中使用通配符展开。--no-passive-ftp 禁用“passive”传输模式。--preserve-permissions 保留远程文件的权限。--retr-symlinks 递归目录时,获取链接的文件 (而非目录)。WARC options:--warc-file=FILENAME save request/response data to a .warc.gz file.--warc-header=STRING insert STRING into the warcinfo record.--warc-max-size=NUMBER set maximum size of WARC files to NUMBER.--warc-cdx write CDX index files.--warc-dedup=FILENAME do not store records listed in this CDX file.--no-warc-compression do not compress WARC files with GZIP.--no-warc-digests do not calculate SHA1 digests.--no-warc-keep-log do not store the log file in a WARC record.--warc-tempdir=DIRECTORY location for temporary files created by theWARC writer.递归下载:-r, --recursive 指定递归下载。-l, --level=NUMBER 最大递归深度 (inf 或 0 代表无限制,即全部下载)。--delete-after 下载完成后删除本地文件。-k, --convert-links 让下载得到的 HTML 或 CSS 中的链接指向本地文件。--backups=N before writing file X, rotate up to N backup files.-K, --backup-converted 在转换文件 X 前先将它备份为 X.orig。-m, --mirror -N -r -l inf --no-remove-listing 的缩写形式。-p, --page-requisites 下载所有用于显示 HTML 页面的图片之类的元素。--strict-comments 用严格方式 (SGML) 处理 HTML 注释。递归接受/拒绝:-A, --accept=LIST 逗号分隔的可接受的扩展名列表。-R, --reject=LIST 逗号分隔的要拒绝的扩展名列表。--accept-regex=REGEX regex matching accepted URLs.--reject-regex=REGEX regex matching rejected URLs.--regex-type=TYPE regex type (posix|pcre).-D, --domains=LIST 逗号分隔的可接受的域列表。--exclude-domains=LIST 逗号分隔的要拒绝的域列表。--follow-ftp 跟踪 HTML 文档中的 FTP 链接。--follow-tags=LIST 逗号分隔的跟踪的 HTML 标识列表。--ignore-tags=LIST 逗号分隔的忽略的 HTML 标识列表。-H, --span-hosts 递归时转向外部主机。-L, --relative 只跟踪有关系的链接。-I, --include-directories=LIST 允许目录的列表。--trust-server-names use the name specified by the redirectionurl last component.-X, --exclude-directories=LIST 排除目录的列表。-np, --no-parent 不追溯至父目录。本文来自互联网用户投稿,文章观点仅代表作者本人,不代表本站立场,不承担相关法律责任。如若转载,请注明出处。 如若内容造成侵权/违法违规/事实不符,请点击【内容举报】进行投诉反馈!