【小样本基础】元学习(Meta Learning)为什么能解决小样本问题(Few-shot Learning):一个例子搞懂

元学习(meta learning)是解决小样本问题非常重要的一个方法

在小样综述Generalizing from a Few Examples: A Survey on Few-shot Learning 中对元学习有这样的描述:

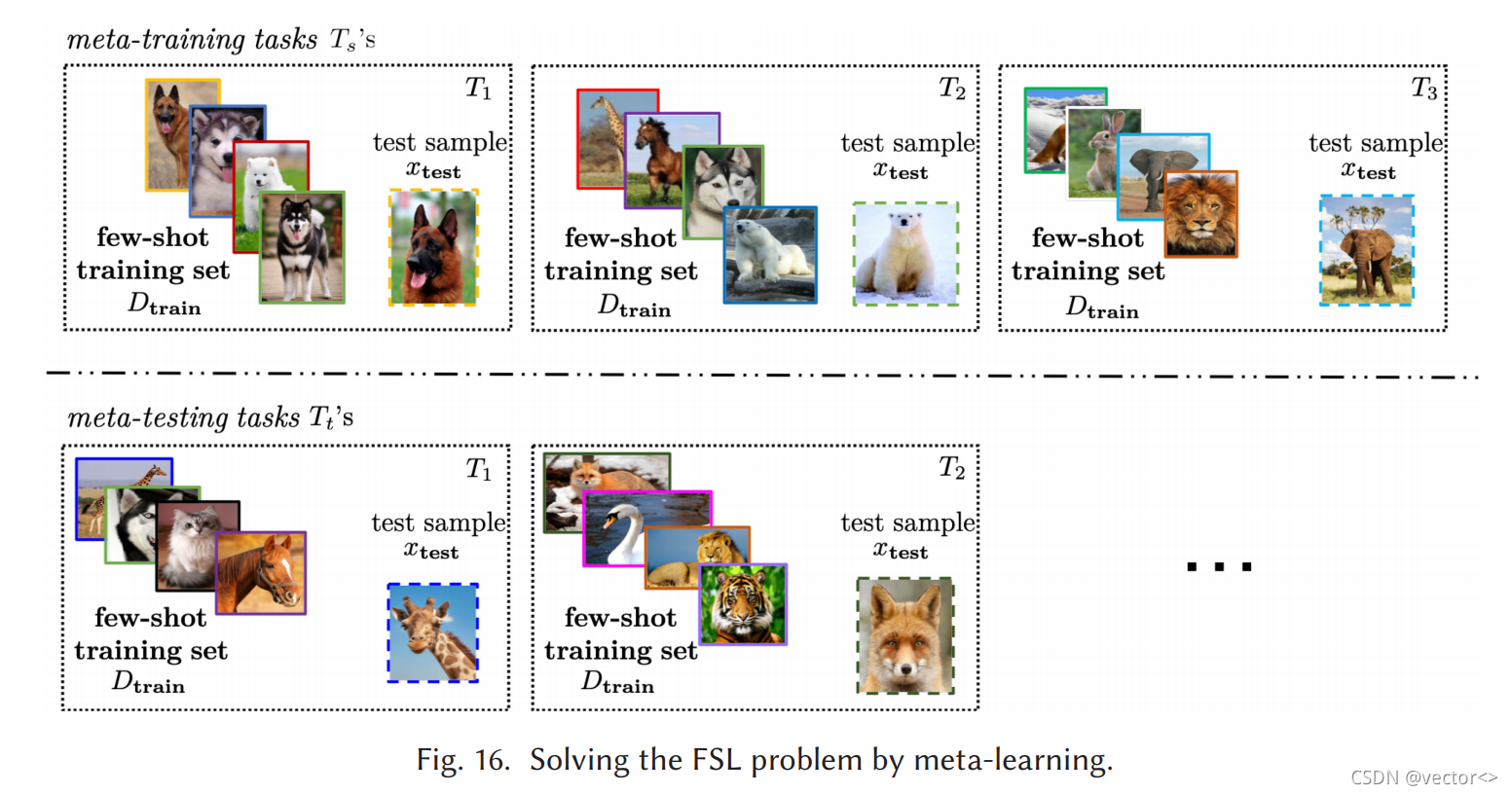

经过一组训练任务得到多个网络参数,使得所有网络的损失最小。用另一组不相交的任务来训练模型的泛化能力,这组任务的平均损失就是元学习的测试误差。

」是不是还是有点摸不着头脑?元学习是“学习如何学习”,这句话到底是什么意思?为什么这样一种方法就能够解决小样本问题呢?

在论文A Method of Few-Shot Network Intrusion Detection Based on Meta-Learning Framework有一个很好的解释。

我们举一个异常流量监测的简单例子:

- 有五种类型的网络流量样本,表示为O、A、B、C 和 D

- O :正常样本,是通常容易获得

- A、B、C、D是四个不同类型的恶意样本

本文来自互联网用户投稿,文章观点仅代表作者本人,不代表本站立场,不承担相关法律责任。如若转载,请注明出处。 如若内容造成侵权/违法违规/事实不符,请点击【内容举报】进行投诉反馈!